深度学习作为人工智能领域的核心技术,近年来取得了巨大的发展,其在计算机视觉、自然语言处理、语音识别等多个领域中展现出巨大的应用潜力。然而,深度学习的快速进步和创新,离不开强大计算能力的支撑。GPU(图形处理单元)作为深度学习训练中至关重要的硬件设备,已成为研究人员和开发者进行大规模数据处理和模型训练的必备工具。在这方面,国外GPU服务器的使用显得尤为重要,它们具备性能上的优势、可扩展性、以及更强的技术支持。本文将从多个角度分析深度学习研究为何需要依赖国外GPU服务器。

深度学习模型的训练过程通常需要大量的计算资源,特别是在处理大规模数据集时,CPU难以满足高效运算的需求。GPU在并行处理方面具有天然的优势,能够大幅度加速矩阵运算和数据处理。国外GPU服务器通常配备了更为先进的显卡,如NVIDIA A100、V100等高端GPU,这些设备支持更高的计算能力和更高的内存带宽,能够在训练大规模深度学习模型时大幅提高效率。相比国内的GPU服务器,国外服务器在硬件性能上的优势,通常能在更短时间内完成更为复杂的计算任务。

随着深度学习应用的不断拓展,国内的GPU资源需求也呈现爆炸式增长。尽管国内各大云服务商已投入大量资金和技术来建设GPU服务器集群,但与需求的快速增长相比,现有的资源仍然存在较大缺口。例如,一些热门GPU型号往往供不应求,甚至需要排队购买,导致研究人员面临延迟交付的困境。而国外的GPU服务器提供商,如Amazon Web Services(AWS)、Google Cloud和Microsoft Azure等,已经在全球范围内布局,提供了更为丰富的计算资源选择,且支持随时按需扩展。对于深度学习研究人员来说,选择国外GPU服务器能够有效避免国内资源紧张带来的困扰。

国外的GPU服务器提供商通常在全球范围内有着更为成熟的基础设施和服务体系。例如,AWS和Google Cloud不仅提供强大的GPU计算能力,还配备了自动化运维、数据备份、实时监控等一系列配套服务。这些国际化平台通过云计算技术,能够提供按需服务,极大地方便了深度学习研究人员进行实验和部署。而且,这些平台支持跨国数据访问,能够满足不同地域研究人员的需求。而国内的服务商虽然也在努力提升服务质量,但由于基础设施建设、数据传输等方面的差距,依旧无法与国外平台在全球化服务上相媲美。

国外的GPU服务器通常采用世界领先的硬件技术,并与全球顶尖的人工智能研究机构和企业合作。这些服务器不仅能够支持最新的GPU型号,还能提供更强的存储能力、更高的带宽和更低的延迟,确保深度学习研究中的大数据处理能够高效完成。此外,国外云平台还能够提供针对深度学习的技术支持,包括深度学习框架的优化、硬件加速的配置等,这些支持往往能够大大提高研究效率。相比之下,国内的GPU服务器在硬件更新、技术支持的速度和质量上,通常会有所滞后。

随着人工智能技术的不断发展,国际间的学术交流和技术合作日益频繁。深度学习研究往往需要大量跨境的数据交换和合作,而国外GPU服务器平台因其全球化布局,能够提供更加便捷的跨国合作支持。例如,研究人员可以将实验数据存储在云端,与其他国家的同行共同进行数据共享和联合建模。而国内的服务器由于政策限制、数据传输速度等问题,可能会面临较多的障碍。因此,国外GPU服务器不仅能够提高研究效率,还能为深度学习领域的国际合作提供坚实的基础。

综上所述,深度学习研究需要依赖国外GPU服务器,主要是因为其在计算能力、资源可用性、技术支持和国际合作等方面的优势。随着深度学习技术的不断发展,GPU的计算能力将愈发重要,而国外的GPU服务器因其在硬件、服务和基础设施方面的领先优势,成为了许多深度学习研究人员和企业的首选。未来,随着全球科技的进一步融合,国外GPU服务器将继续为深度学习研究提供强有力的支持,助力人工智能技术的飞速发展。

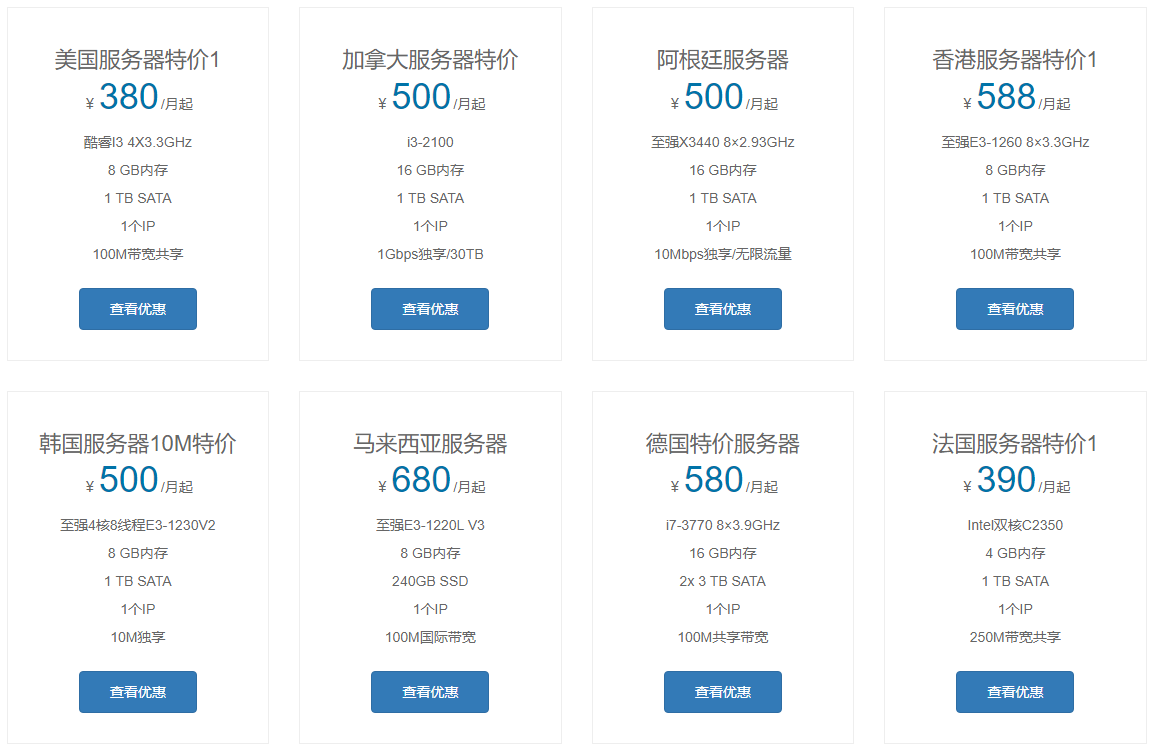

国外服务器为您在国外外贸业务开展提供技术支持服务,24小时技术咨询热线400-808-5836,微信号fobhostcom。